Nová éra hraček s lidskými rysy

Spolupráce mezi Mattelem a OpenAI má za cíl vytvořit produkty, které využijí pokročilé technologie umělé inteligence pro věkově přiměřené herní zážitky. První produkt by měl být představen ještě letos. Prodej se ovšem pravděpodobně rozběhne až v roce 2026. Zatím není jasné, jakou podobu tyto hračky budou mít, spekuluje se však o tom, že nebudou určeny dětem mladším 13 let. Mattel se nechal slyšet, že při vývoji nových produktů klade důraz na bezpečnost, soukromí a věkovou přiměřenost.

Experti z prestižních univerzit včetně Harvardu a Carnegie Mellon však vyjadřují vážné pochybnosti. Jejich výzkumy totiž ukazují, že děti mají tendenci přisuzovat umělé inteligenci lidské vlastnosti, což může mít negativní dopad na jejich sociální vývoj.

Největší obavou je fakt, že děti nemají ještě dostatečně vyvinuté kognitivní schopnosti k tomu, aby dokázaly plně rozlišit mezi realitou a hrou. Hračky s lidskými hlasy, které dokážou vést přirozenou konverzaci, tak mohou způsobit skutečné problémy v jejich vývoji.

Když se hra stane závislostí

Tragickým příkladem toho, kam může zavést nadměrná interakce s umělou inteligencí, je případ čtrnáctiletého chlapce, který si vzal život poté, co se stal posedlý chatbotem ze služby Character.AI. Mladík málo spal, propadal se do deprese a nakonec usínal ve škole. Stal se závislým na rozhovorech s AI postavou z populárního seriálu, se kterou údajně navázal romantický vztah.

Tento extrémní případ ukazuje, jak nebezpečné může být, když se hranice mezi realitou a umělým světem začnou stírat. Děti mohou začít preferovat společnost AI hraček před skutečnými přáteli, což může vážně narušit jejich schopnost navazovat mezilidské vztahy.

Mattel už v bezpečnosti zklamal

Není to poprvé, co se Mattel pustil do technologických experimentů s rozporuplnými výsledky. V roce 2015 uvedl na trh panenku Hello Barbie, která byla připojena k Wi-Fi a dokázala s dětmi komunikovat. Hračka však kladla osobní otázky o dětech a jejich rodinách, přičemž zvukový záznam posílala třetí straně, která pomocí AI generovala odpovědi.

Kampaň za ochranu dětí před nevhodným marketingem rychle upozornila na riziko sledování dětí. Situace se ještě zhoršila, když bezpečnostní experti objevili zranitelnosti umožňující útočníkům odposlouchávat rozhovory. Mattel nakonec hračku v roce 2017 stáhl z prodeje. Další trapas zažila společnost teprve nedávno, v listopadu 2024, kdy chyba na obalu panenky z filmu Wicked odkazovala na pornografický web místo na oficiální stránky filmu.

Nepředvídatelnost umělé inteligence

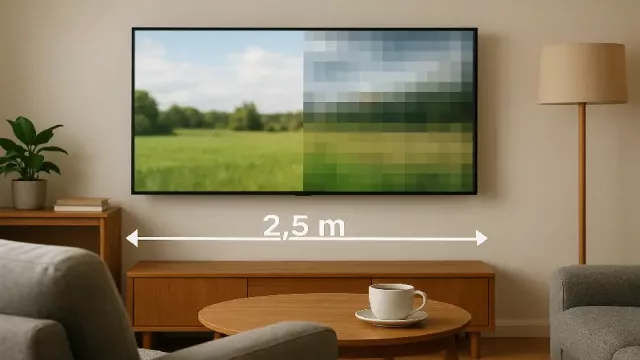

Kritici poukazují na zásadní problém současných AI systémů - jejich nepředvídatelnost. Umělá inteligence je známá tím, že občas „halucinuje“ nebo poskytuje nevhodné až škodlivé rady. I přes ujištění o bezpečnostních opatřeních není možné garantovat, že AI hračky nebudou někdy reagovat nevhodně nebo dokonce nebezpečně.

Dalším problémem jsou předsudky zakódované v jazykových modelech, na kterých je ChatGPT postaven. Tyto systémy mohou neúmyslně reprodukovat stereotypy nebo kulturně nevhodný obsah, což může ovlivnit perspektivu a sociální vývoj dětí. AI hračky také pravděpodobně budou zpracovávat hlasová data dětí, jejich behaviorální vzorce a osobní preference. To vyvolává otázky o tom, jak budou tato citlivá data ukládána, kdo k nim bude mít přístup a co se stane v případě úniku informací.

Konečné rozhodnutí zůstává na rodičích, kteří budou muset pečlivě zvážit, zda chtějí své děti vystavit této nové technologii. Jisté je, že doba, kdy byly hračky pouze pasivními objekty, definitivně končí. Otázkou je, zda jsme na tuto změnu připraveni.

Zdroj: Mattel, Malwarebytes, Reuters, CBSnews, Arstechnica

Článek obsahuje prvky vygenerované AI