Křivolaká inteligence: génius a hlupák v jednom

Demis Hassabis, šéf Google DeepMind, tento fenomén nazývá „křivolakou inteligencí“ (v originále „jagged intelligence“). Současné modely v některých úlohách dramaticky překonávají lidské schopnosti, ale v jiných, zdánlivě banálních, trestuhodně selhávají. I ty nejlepší systémy, které excelují v náročných soutěžích, mohou náhodně pochybit v úkolu, který by zvládl i žák základní školy.

Podle Hassabise nestačí jen přidat víc výpočetní síly nebo nahrát do AI víc dat. Potřebujeme lepší způsoby testování a hlavně vylepšit to, jak AI "přemýšlí". Spolehlivá umělá inteligence musí umět lépe plánovat, pamatovat si věci dlouhodobě a logicky uvažovat.

Proč je tato nespolehlivost tak závažná

Nejde jen o teoretický problém. Když chceme používat AI v medicíně, v samořiditelných autech nebo ve vědeckém výzkumu, musíme se na ni umět spolehnout. Nemůže fungovat jednou dobře a podruhé špatně.

Největší riziko spočívá v tom, že zatím nedokážeme přesně určit, ve kterých typech úloh bude konkrétní model úspěšný a kde naopak bude chybovat. Dokud nebude tato nespolehlivost odstraněna, nasazení AI v kritických aplikacích bude vždy spojeno s velkým rizikem.

Cesta ke spolehlivé umělé inteligenci

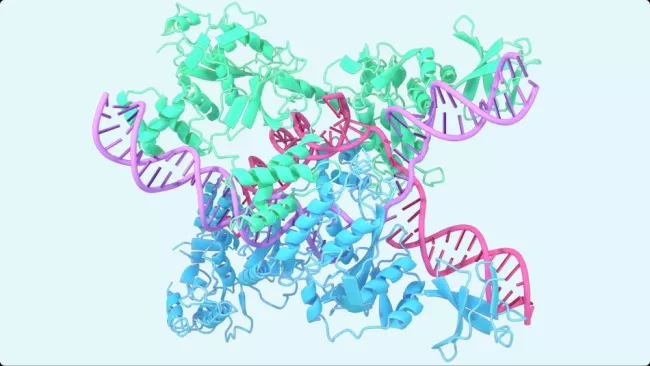

Navzdory popsaným problémům slaví AI ohromné úspěchy. Příkladem je model AlphaFold2 od DeepMind, který způsobil revoluci v biologii přesnou predikcí proteinových struktur. Jeho tvůrci za to získali Nobelovu cenu.

Veškerý další vývoj ale závisí na tom, jestli se podaří vyřešit tento problém. Nejde ani tak o to udělat AI ještě chytřejší, ale o to, aby byla spolehlivá a abychom věděli, na co se můžeme spolehnout a na co ne. Až tehdy z ní bude opravdu užitečný pomocník, který nebude představovat riziko.

Zdroj: Business Insider, Times of India, YouTube/Institute for Advanced Study