Problém, který roste rychleji než jeho řešení

Ještě před deseti lety bylo falzifikování fotografie záležitostí profesionálů. Dnes zvládne přesvědčivý falešný obrázek vygenerovat prakticky kdokoliv. Stačí chytrý telefon a volně dostupná aplikace. Miliardy lidí mají přístup k nástrojům, které během vteřin vytvoří fotorealistický snímek na základě libovolného textového popisu.

Výsledky jsou alarmující. Sociální sítě jsou plné falešných videí z válečných zón: hořící budovy, sestřelená letadla, zoufalí vojáci. Tyto záběry mají jedno společné: vypadají přesvědčivěji než realita. Jsou dramatičtější, filmovější, přesně takové, jaké si mozek zvyklý na hollywoodské produkce automaticky spojuje s „pravdivým“ záběrem.

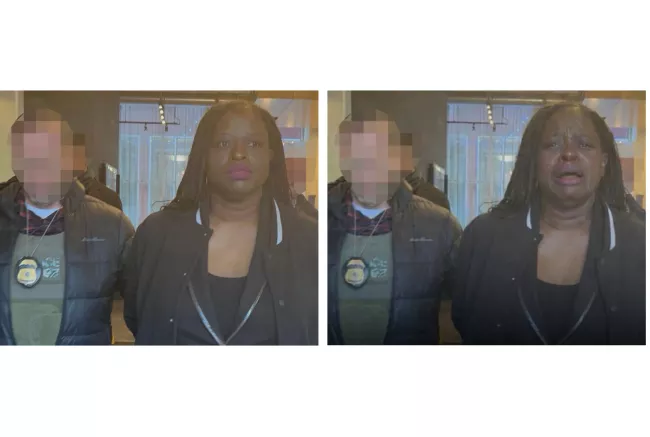

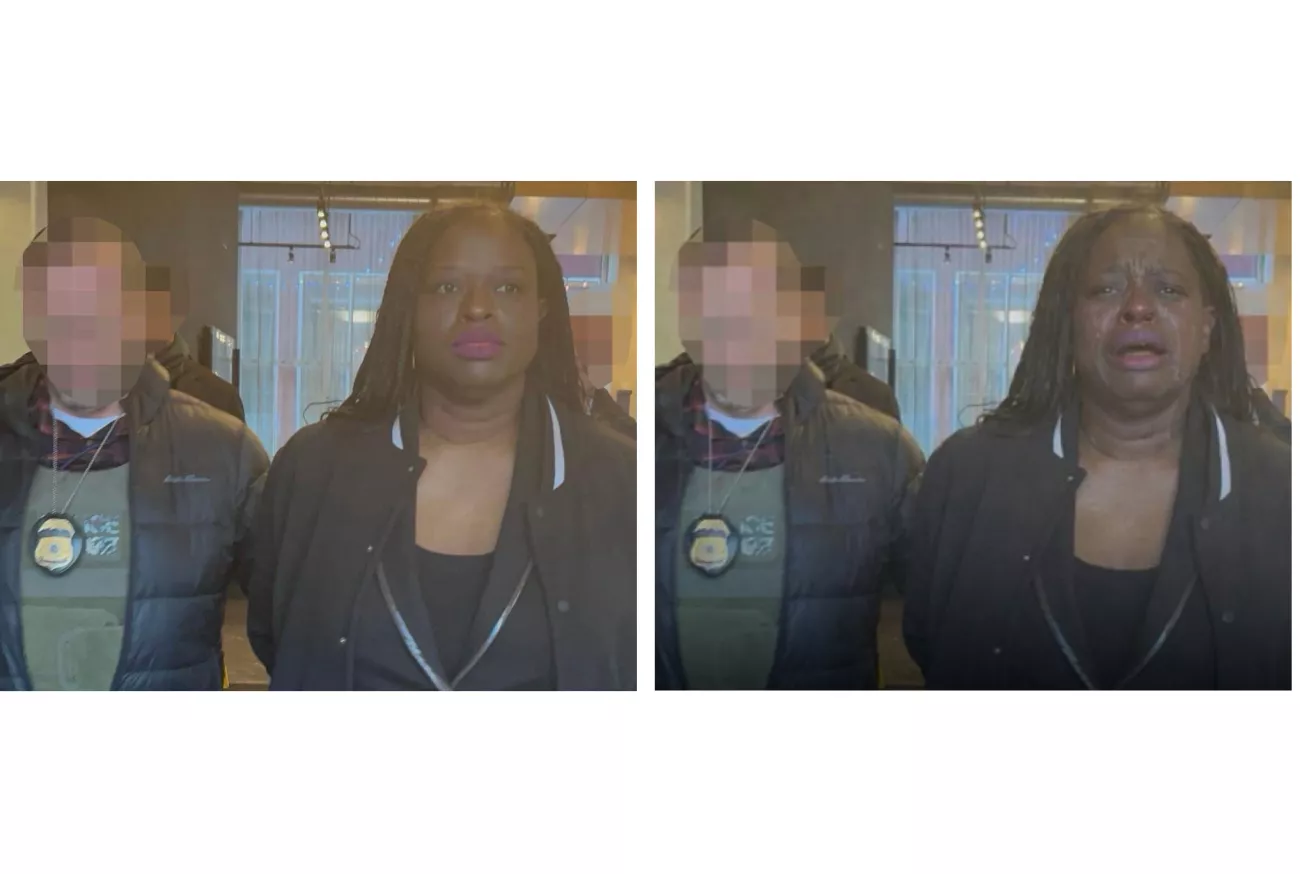

Falzifikáty se nevyhýbají ani politice: Byl zdokumentován případ, kdy byl na oficiálním účtu Bílého domu zveřejněn upravený snímek zatčené ženy — úprava měla navodit dojem, že pláče. Jinde AI odstranila masku z tváře policisty a výsledný snímek byl použit k falešné identifikaci nevinného člověka.

Jak deepfaky vznikají a proč jsou tak přesvědčivé

Termín „deepfake“ vznikl z názvu anonymního uživatele sociální sítě Reddit, který okolo roku 2017 začal vytvářet pornografická videa s digitálně vloženými tvářemi celebrit. Tehdy AI potřebovala tisíce fotografií konkrétního člověka, aby dokázala vytvořit věrohodnou imitaci. Dnes postačí jen zlomek takového množství dat.

Moderní generátory obrazu se naučily napodobovat i detaily, které dříve falza prozrazovaly — šum snímače, kompresní artefakty nebo specifické optické vady objektivu. Rané AI obrázky bylo snadné odhalit podle šestiprstých rukou nebo nesmyslných textů na tabulích. Tyto chyby z nových modelů prakticky vymizely.

Zvláštní kategorií jsou takzvané lip-sync deepfaky. Fungují tak, že se naklonuje hlas skutečné osoby, vygeneruje se zvukový záznam, ve kterém říká cokoliv, a poté se upraví existující video, aby pohyby rtů odpovídaly nahrávce. Takto lze přimět kohokoliv — politika, novináře, generálního ředitele — „říct“ věci, které nikdy neřekl.

Fyzika jako poslední obranná linie

Přestože AI v generování obrazu udělala obrovský pokrok, naráží na jeden zásadní problém: nerozumí fyzice reálného světa. A právě tady se otevírá prostor pro odhalení falzifikátů.

Konkrétně jde o takzvaný úběžník, tedy vanishing point. Bod, do kterého se sbíhají v realitě rovnoběžné přímky při pohledu v perspektivě. Podlahové dlaždice, kolejnice, okraje budov — vše sleduje tento princip. U AI generovaných snímků se tyto přímky nezřídka míjejí nebo sbíhají do více různých bodů, což ve skutečnosti není možné.

Stejný princip funguje u odrazů a stínů. Sluneční paprsky dopadají na Zemi prakticky rovnoběžně, takže přímky spojující objekty s jejich stíny se vždy sbíhají v jednom bodě. AI to dosud nedokáže spolehlivě dodržet. Stačí přiložit pravítko k monitoru a nesrovnalost okamžitě vyjde najevo.

Podobně funguje analýza světelných podmínek. Pokud jsou na snímku dva objekty osvětleny z různých směrů, přestože se nacházejí ve stejné scéně, je to spolehlivý příznak manipulace.

Proč je ověření pravosti těžší než odhalení falše

Zde se dostáváme k paradoxu, který bezpečnostní experti považují za jeden z největších problémů současnosti: dokázat, že něco je pravé, je obtížnější než prokázat, že jde o falzum.

Když analyzujeme falešný snímek, hledáme konkrétní chybu: nesedící stín, špatný úběžník, nerealistický odraz. Jakmile chybu najdeme, máme důkaz. Jenže pokud analyzujeme pravý snímek a žádnou chybu nenajdeme, neznamená to automaticky, že je pravý. Jen jsme žádnou chybu nenašli.

V praxi to způsobuje psychologický efekt: čím déle se na reálný snímek díváme a nic divného na něm nezpozorujeme, tím méně jsme si jisti. Naše sebedůvěra neroste. U falzifikátů stačí jeden odhalený artefakt a jsme si okamžitě jisti.

Nástroje, které pomáhají a jejich limity

V posledních letech vznikla řada automatizovaných nástrojů pro detekci deepfaků. Trénují se na rozsáhlých datových sadách označených snímků a učí se rozpoznávat vzory typické pro AI generovaný obsah. Některé z těchto modelů jsou v detekci lepší než průměrný člověk.

Jejich zásadní slabinou je ale omezená generalizace. Detektor natrénovaný na snímcích z jednoho generátoru si neporadí s výstupem jiného nástroje. Pokud se výrazně změní způsob generování nebo komprese obrazu, model selže. Navíc v soudní síni nebo redakci nestačí říct „algoritmus to označil jako falzum“ — je třeba vysvětlit, proč.

Právě proto odborníci upřednostňují kombinaci automatické analýzy s manuálním zkoumáním fyzikálních principů. Stroj může upozornit na podezřelý snímek, ale závěr musí stát na ověřitelném, vysvětlitelném základě.

Mohlo by vás zajímat

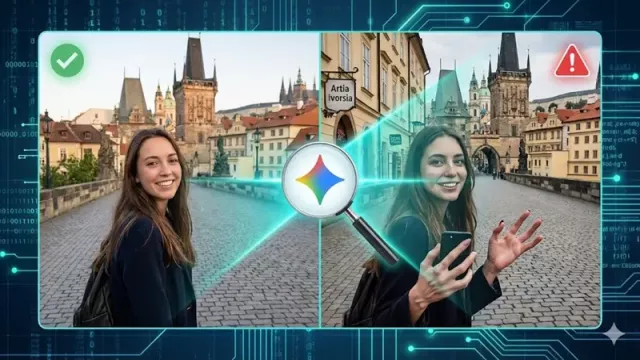

Pozná AI dílo jiné AI? Google Gemini nově dokáže odhalovat obrázky vytvořené umělou inteligencí

Co může udělat každý z nás

Profesionální digitální forenzika je specializovaný obor. Přesto existují jednoduché návyky, které může uplatnit každý:

- Zastavte se u dramatických záběrů. Snímky a videa, které vypadají příliš filmově, příliš perfektně nebo jsou mimořádně emotivní, si zaslouží zvýšenou pozornost. AI obsah bývá záměrně atraktivnější než realita, protože tak se lépe šíří.

- Sledujte zdroj. Kdy byl obsah zveřejněn? Kdo ho sdílí jako první? Anonymní nebo nově vzniklé účty sdílející virální záběry z aktuálních konfliktů jsou varovným signálem.

- Zkuste test pomocí úběžníku. Otevřete podezřelý snímek v libovolném editoru nebo si přiložte pravítko k obrazovce. Sbíhají se rovnoběžné linie scény do jednoho bodu? Dávají stíny smysl z hlediska zdroje světla?

- Hledejte reflexe. Odraz v okně, zrcadle nebo na vodní hladině je pro AI stále obtížné generovat fyzikálně správně.

- Nejdůležitější zbraní proti dezinformacím není technologie — je to zdravá skepse a ochota si věci ověřit.

Mohlo by vás zajímat

Deepfake: Když už nevíte, komu věřit

Souboj s deepfaky nelze vyhrát, ale ani vzdát

Pravdou je, že generátory AI obrazu se budou dál rychle zlepšovat. Část dnešních slabých míst — úběžníky, fyzika stínů, konzistentnost odrazů — možná za několik let zmizí stejně, jako zmizely šestiprsté ruce.

Přesto platí, že cílem není absolutní vítězství nad každým falešným obrázkem. Každý odhalený podvod, každý novinář nebo uživatel sociální sítě, který si před sdílením ověří obsah, celý systém posiluje. Funguje podobně jako zámek na dveřích. Nezabrání každému vloupání, ale odradí drtivou většinu pokusů. A to je v době, kdy každý den vznikají miliony AI snímků, více než dost důvodů pokračovat.

V lednu Bílý dům zveřejnil fotografii ženy zadržené během protestů proti americké imigrační a celní službě, která byla upravena pomocí umělé inteligence. (První obrázek) KRISTINOEM/X.COM; (druhý obrázek) WHITEHOUSE/X.COM.

Science

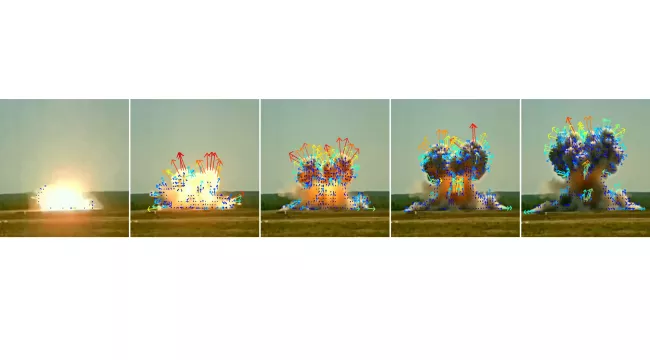

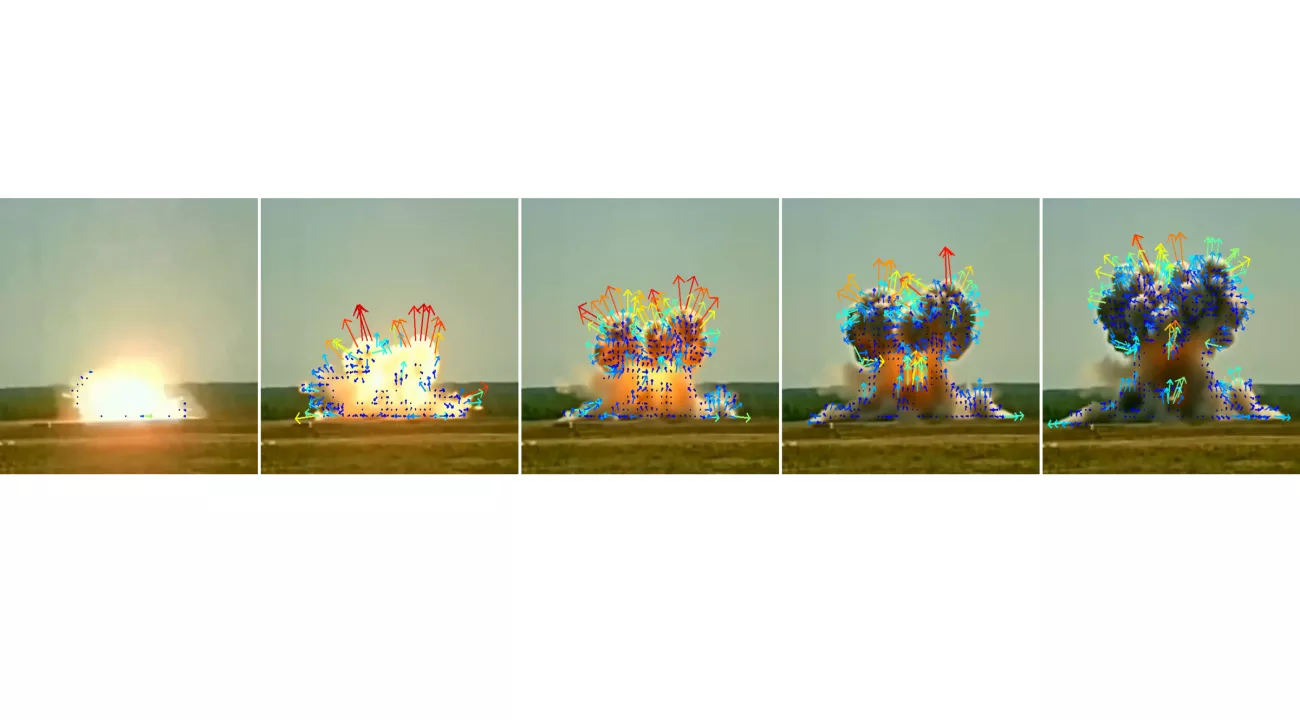

Výbuchy generované umělou inteligencí bývají často přehnaně dramatické a doprovázené velkými oblaky kouře. Pozorování toho, jak se výbuchy vyvíjejí v jednotlivých snímcích, může pomoci odhalit, které jsou skutečné a které falešné.

Science

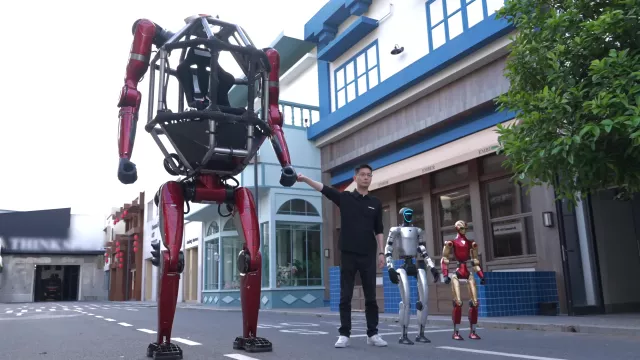

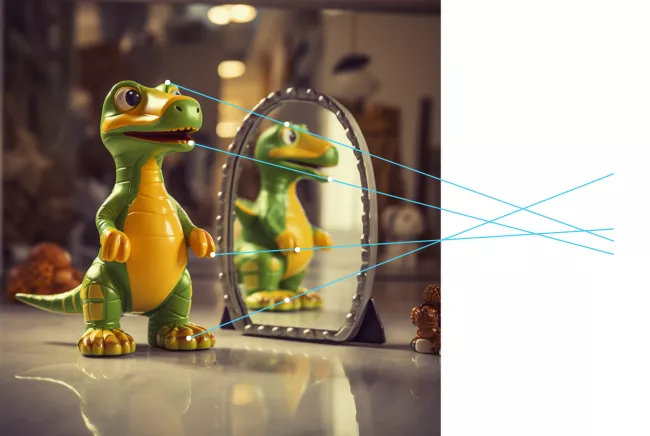

Podobně lze kontrolovat odrazy. Přímky spojující body na objektu s odpovídajícími body v jeho zrcadlovém obrazu jsou v realitě rovnoběžné, a proto by se rovněž měly sbíhat v úběžníku. Na tomto obrázku se čáry opět nesbíhají v jednom bodě, což prozrazuje, že se jedná o padělek.

Science

PŘEJÍT DO GALERIE

(6 FOTOGRAFIÍ)