Hra s čísly kolem spotřeby energie

Diskuse o energetické náročnosti umělé inteligence se často točí kolem konkrétních čísel, která však často nejsou příliš spolehlivá. Sam Altman z OpenAI nedávno na svém blogu uvedl, že dotaz na ChatGPT v průměru spotřebuje asi 0,34 watthodin energie - což odpovídá asi vteřině provozu trouby nebo několika minutám svícení energeticky úsporné žárovky. Co se týče vody, jeden dotaz podle něj spotřebuje přibližně jednu patnáctinu čajové lžičky, tedy asi 0,0003 litru.

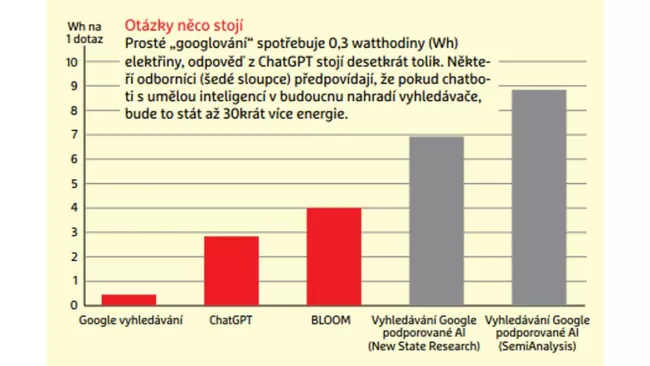

Tato čísla však vyvolávají otázky. Například jak přesně byla spotřeba vypočítána a co všechno zahrnuje? Jiné odhady se totiž liší. Washington Post ve spolupráci s výzkumníky odhadl, že vytvoření jediného emailu se 100 slovy pomocí ChatGPT GPT-4 vyžaduje „něco více než láhev vody“ pro chlazení datových center. Nezisková organizace Electric Power Research Institute zase uvádí, že ChatGPT dotaz spotřebuje 2,9 watthodin, zatímco tradiční Google vyhledávání jen asi 0,3 watthodin.

Kde vzít data

Problém spočívá v tom, že většina velkých technologických společností neposkytuje podrobné informace o dopadech svých AI systémů. Uživatelé tak v podstatě naslepo používají technologie s neznámými ekologickými dopady. Tato netransparentnost vede k šíření nepodložených tvrzení. Často citovaný údaj, že ChatGPT dotaz spotřebuje desetkrát více energie než Google vyhledávání, pochází z neformálního komentáře předsedy představenstva Alphabetu z roku 2023. Přesto se toto číslo stalo základem pro mnoho politických a mediálních diskusí o AI.

Bez ohledu na přesná čísla je jasné, že datová centra představují stále větší zátěž pro energetické sítě. V Irsku by datová centra mohla do roku 2026 spotřebovávat až třetinu veškeré elektřiny v zemi. V roce 2022 již spotřebovávala 17 % celkové spotřeby, což odpovídá spotřebě všech městských obytných budov.

Podobný trend se objevuje i v dalších evropských zemích. Dánsko s 34 datovými centry očekává, že do roku 2026 budou spotřebovávat téměř 20 % celkové spotřeby elektřiny. Severské země jako Švédsko a Norsko se stávají atraktivními pro datová centra díky chladnějšímu klimatu a nízkoemisní elektřině.

Firemní strategie a dopady na prostředí

Velké technologické společnosti reagují na rostoucí energetické nároky různě. Microsoft a Amazon v USA sází na jadernou energii, aby pokryly své potřeby bez zvyšování emisí CO2. Microsoft přitom hlásí nárůst emisí o téměř 30 % od roku 2020 kvůli rozšiřování datových center. Google má emise skleníkových plynů v roce 2023 o téměř 50 % vyšší než v roce 2019.

Současně se odhaduje, že spotřeba energie umělou inteligencí představuje jen asi 2-3 % globálních emisí. Tento podíl však pravděpodobně poroste s dalším rozšiřováním AI technologií.

Výzkum open-source modelů ukazuje, že různé AI systémy mají značně odlišnou energetickou náročnost. Některé modely spotřebují až o 50 % více energie než jiné při odpovídání na stejné dotazy. Složitější modely, které poskytují podrobnější a přesnější odpovědi, logicky spotřebovávají více energie kvůli většímu množství výpočtů.

Výhledy

Technologické společnosti už částečně optimalizují energetickou náročnost tím, že pro jednodušší dotazy používají méně náročné modely. Toto „inteligentní směrování“ dotazů by mohlo výrazně snížit celkovou spotřebu energie.

Sam Altman se k budoucnosti staví optimisticky a věří, že po roce 2030 bude k dispozici prakticky neomezená inteligence i energie. Zdali se tento optimismus naplní, ukáže čas. Jisté je, že s rostoucím využíváním AI bude otázka energetické náročnosti stále důležitější pro další rozvoj těchto technologií.

Výzva pro nejbližší roky spočívá v zajištění transparentnosti a vytvoření standardů pro měření dopadů AI systémů na životní prostředí. Bez těchto informací je obtížné rozhodovat o udržitelném rozvoji umělé inteligence.

Zdroj: Sam Altman blog, Euronews, Datacenter map, Joule, Swyrl, Wired